Auteur; David Chandross - Associate lecturer, Masters of Digital Media Program, and Senior Scholar in the field of Aging and Technology, Ted Rogers School of Management, Toronto Metropolitan University

The Conversation - CC BY ND

Chaque année des centaines d’étudiants âgés se rassemblent à Toronto, convoqués en personne ou en ligne, dans l’attente fébrile de leur diplôme.

Certains d’entre eux ont plus de 90 ans, d’autres sont atteints de démence.

Une diplômée, qui a terminé 15 cours donnés par la faculté de l’Université Ryerson, a déjà été directrice artistique pour Madonna. Elle a soutenu une thèse selon laquelle la conception de l’art du philosophe prussien Emmanuel Kant était supérieure à celle du philosophe écossais David Hume. Kant estimait que l’art était basé sur l’intention, Hume disait qu’il était une habileté.

Durant le cours, cette étudiante pouvait fort bien défendre son argumentation rationnellement. La semaine suivante, elle ne s’en souvenait guère. Mais à ce moment précis, celui-là où les patients atteints de démence se retrouvent, existentiellement, elle était présente.

Et les bénéfices vont au-delà de la présence. La participation à l’enseignement supérieur peut aussi modérer la perte de la fonction cognitive associée au vieillissement et à la maladie d’Alzheimer.

Gill Livingston et son équipe qui dirigent la commission The Lancet sur la démence o nt démontré que la résilience peut aider à ralentir la progression de la démence ou à en retarder l’apparition. L’idée sous-jacente à la résilience est un concept nommé réserve cognitive. Les facteurs de mode de vie tels que l’alimentation et la forme physique – et aussi l’apprentissage – rehaussent la réserve cognitive. Une réserve cognitive accrue permet de lutter contre la perte de mémoire.

DE LA PHILOSOPHIE A LA NEUROPSYCHOLOGIE

Au cours des quatre dernières années, l’Université Ryerson, en association avec Baycrest Health Sciences, a offert jusqu’à 20 cours par année aux personnes âgées. Certaines d’entre elles sont atteintes de démence, d’autres pas – elles sont assises côte à côte en classe.

Les cours sont de sérieuses sessions intensives de deux heures pendant huit semaines. Parmi les sujets on compte la philosophie de Socrate, l'astronomie, la neuropsychologie, le romantisme et les grands artistes, la musique classique, les grands réalisateurs, la littérature française et l’archéologie.

Archéologue formée à Harvard, David Lipovitch dirige des cours sur des fouilles qu’il mène au Moyen-Orient. Des journalistes chevronnés au Globe and Mail et des spécialistes de l’histoire de Broadway s’adressent à des classes allant jusqu’à 30 étudiants.

Le secret c’est l’implication – optimiser l’apprentissage pour réduire l’isolation sociale et rehausser l’estime de soi. Ces programmes ne sont pas " ludo-éducatifs ", mais ils rivalisent avec le contenu des vrais programmes universitaires de premier cycle.

Ce qui est différent c’est que les étudiants n’effectuent pas de travaux. On les note sur leur effort à participer. Une étudiante atteinte de démence avancée, tout en étant toujours cohérente, a dit: "J’ai de la difficulté à me remémorer bien des choses et ceci est le moment marquant de ma semaine, alors VOUS n’oubliez pas de m’amener ici la semaine prochaine! "

Ce genre de commentaire est fréquent. Et l’idée même que l’apprentissage organisé a poussé cette patiente à poser une "action métacognitive" – sachant qu’elle est atteinte de démence et qu’elle a besoin de compenser – est impressionnante en soi.

CONNEXITE SOCIALE ET STIMULATION MENTALE

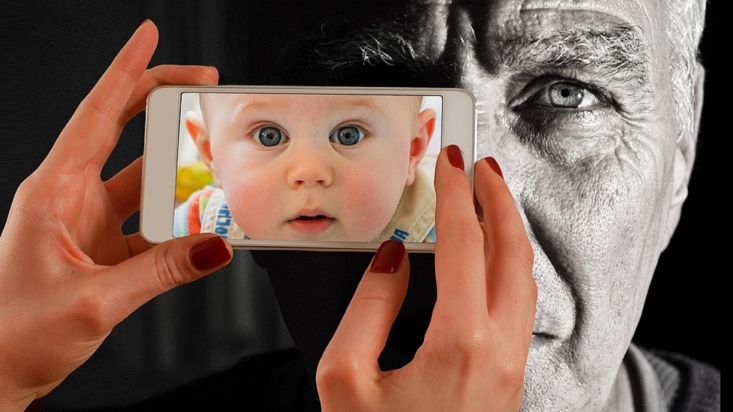

Le rapport de la commission The Lancet a aussi examiné le rôle de l’éducation dès la petite enfance dans le développement de la démence. Les données suggèrent qu’un manque d’accès à l’éducation entraîne une incidence accrue de démence en raison d’une réserve cognitive réduite.

Cela souligne la valeur d’éduquer les personnes âgées durant de longues périodes – non seulement celles qui sont atteintes de démence, mais aussi celles qui sont en santé et à risque de démence.

L’étude marquante de George Rebok en 2014 sur les effets de l’éducation pour les personnes âgées a suivi les participants sur une période de 10 ans, explorant plusieurs aspects de la fonction cognitive. On a noté de petits effets dans l’habileté accrue de penser et des effets plus impressionnants concernant l’hygiène personnelle, l’auto-efficacité et autres mesures de bien-être.

L’apprentissage semble offrir aussi bien la connexité que la stimulation mentale, menant à la résilience sociale par l’augmentation de la réserve cognitive. Le raisonnement et la vivacité de pensée se sont améliorés dans les résultats de Rebok, mais non la mémoire.

On prévoit qu’au moins la moitié de la population humaine aura plus de 50 ans d’ici 2050. (Baycrest Health Sciences). (Baycrest Health Sciences), Author provided

On ne comprend toujours pas si la répétition mentale focalisée par l’apprentissage peut prévenir ou contrer la démence. Des études de Julia Spaniol à l’Université Ryerson démontrent qu’une hausse de l’implication et la motivation chez les personnes âgées aide à débloquer la mémoire. Mais jusqu’à récemment, il n’y avait pas de recherche centrée sur le rôle d’apprentissage plus poussé, comme ces cours universitaires intensifs, sur les conséquences de la démence ou la qualité de vie.

"EUDEMONISME" POUR UNE SOCIETE VIEILLISSANTE

Toutefois, cela est sur le point de changer. Cet été, le Centre for Aging and Brain Health Innovation (CABHI) a accordé une subvention à notre équipe – pour enquêter sur l’utilisation des technologies d’apprentissage, telles que les médias en continu comparativement aux sessions en personne pour les gens atteints de démence ou à risque d’en être frappé.

Le but de ce programme est de créer un accès plus large à des possibilités permanentes d’apprentissage pour les adultes âgés indépendamment de leur lieu de résidence – qu’il s’agisse de soins à long terme ou dans la communauté. Les études cliniques ont débuté en septembre 2018 et nous allons faire rapport sur nos données à la fin du printemps de 2019.

L’espérance de vie augmente et on prévoit qu’au moins la moitié de la population humaine aura plus de 50 ans d’ici 2050. Il faudra que nos esprits restent éveillés et que nos sens soient bien affûtés pour profiter réellement des moments précieux de nos vieux jours.

Socrate parlait d’une idée appelée " eudémonisme ", soit la " floraison dans la vie ". Trop de plaisir et on s’épuise. Trop de détermination et on se tourmente. Mais quand le plaisir et la détermination sont tous deux au plus haut niveau, nous atteignons cet état eudémoniste, selon Deborah Fels, l’une des grandes spécialistes canadiennes sur le vieillissement et l’accessibilité.

Apprendre c’est clairement ce que les humains font de mieux. Nous n’avons pas l’agilité du tigre ni la longévité des séquoias, mais nous apprenons continuellement et c’est ce qui nous distingue. En apprendre sur nous-mêmes et sur le monde peut être le secret du bonheur et de la santé dans les années de l’âge d’or.